DeepSeek-R1, en yeni çıkarım yeteneklerine sahip açık bir modeldir. DeepSeek-R1 gibi çıkarım modelleri, doğrudan yanıtlar sunmak yerine, bir sorgu üzerinde birden fazla çıkarım aşaması gerçekleştirerek zincirleme düşünme (chain-of-thought), fikir birliği (consensus) ve arama (search) yöntemleri kullanarak en iyi cevabı üretir.

Bu çıkarım aşamalarının sıralı olarak gerçekleştirilmesi — yani en iyi yanıta ulaşmak için akıl yürütme sürecinin kullanılması — test zamanı ölçekleme (test-time scaling) olarak adlandırılır. DeepSeek-R1, bu ölçekleme yasasının mükemmel bir örneği olup, Agentic AI çıkarımı için hızlandırılmış hesaplamanın neden kritik olduğunu göstermektedir.

Modellere, bir problemi yinelemeli olarak “düşünerek” çözme imkanı tanındığında, daha fazla çıktı belirteci(token) üretilir ve daha uzun üretim döngüleri oluşur; böylece model kalitesi ölçeklenmeye devam eder. Hem gerçek zamanlı çıkarımı hem de yüksek kaliteli yanıtları etkinleştirmek için büyük çıkarım altyapıları gereklidir.

R1, mantıksal çıkarım, muhakeme, matematik, kodlama ve dil anlayışı gerektiren görevler için üstün doğruluk sunarken, yüksek çıkarım verimliliği de sağlamaktadır.

DeepSeek-R1 NIM Mikroservisi ile Güvenli Geliştirme İmkanı

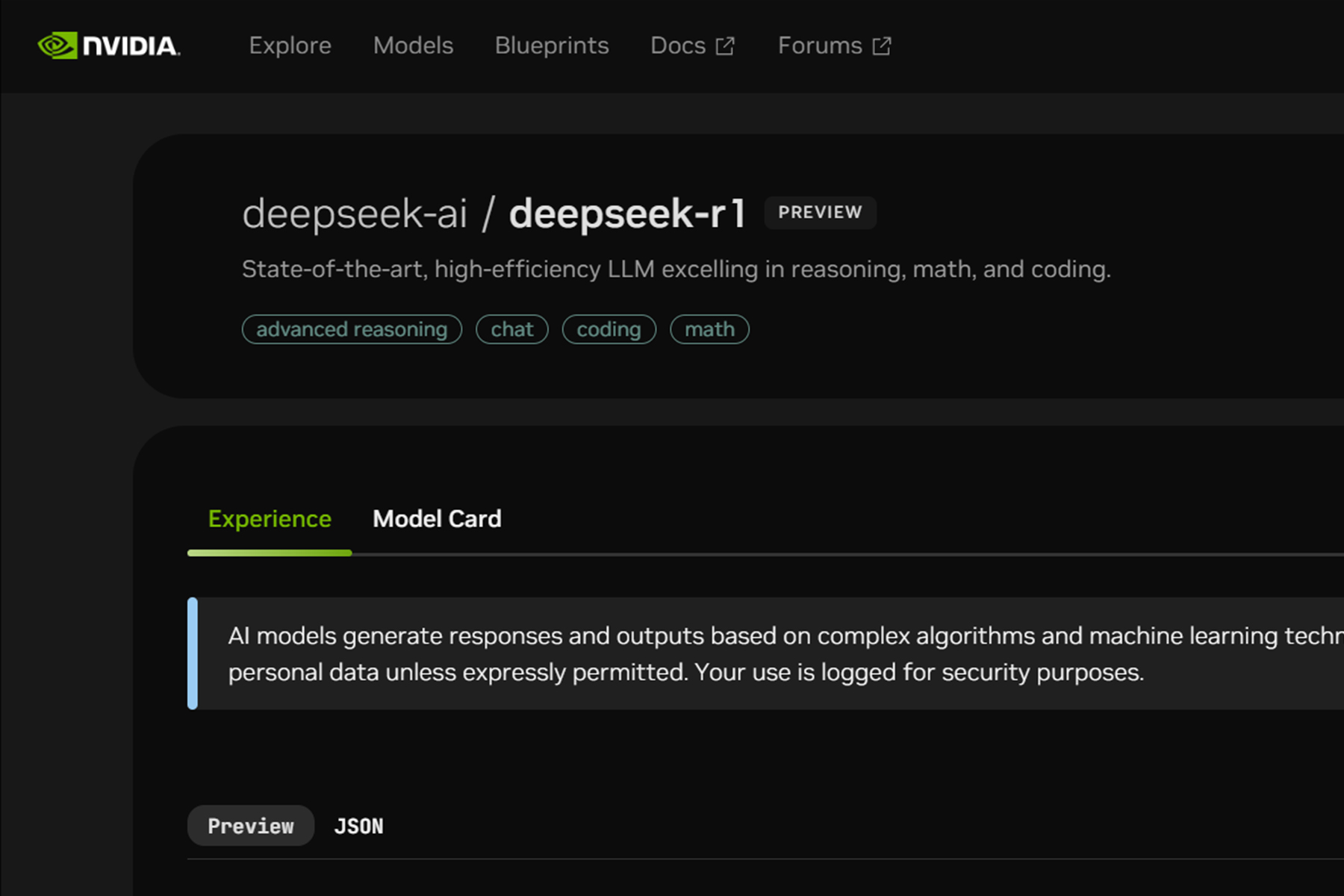

Geliştiricilerin bu yetenekleri güvenli bir şekilde denemelerine ve kendi özel ajanlarını oluşturmalarına yardımcı olmak için, 671 milyar parametreye sahip DeepSeek-R1 modeli artık NVIDIA NIM mikroservis önizlemesi olarak build.nvidia.com üzerinden erişime açılmıştır. DeepSeek-R1 NIM mikroservisi, tek bir NVIDIA HGX H200 sisteminde saniyede 3.872 token’e kadar çıkarım hızı sunabilir.

Geliştiriciler, NVIDIA AI Enterprise yazılım platformunun bir parçası olan indirilebilir bir NIM mikroservisi olarak yakında kullanıma sunulması beklenen uygulama programlama arayüzünü (API) test edebilir ve deneyebilir.

DeepSeek-R1 NIM mikroservisi, endüstri standardı API’leri destekleyerek dağıtımı kolaylaştırır. Kuruluşlar, tercih ettikleri hızlandırılmış hesaplama altyapısında NIM mikroservisini çalıştırarak güvenlik ve veri gizliliğini en üst düzeye çıkarabilirler. Ayrıca, NVIDIA AI Foundry ve NVIDIA NeMo yazılımı kullanarak, özel yapay zeka ajanları için özelleştirilmiş DeepSeek-R1 NIM mikroservisleri oluşturabilecekler.

DeepSeek-R1- Test Zamanı Ölçeklemesinin Mükemmel Bir Örneği

DeepSeek-R1, büyük ölçekli karışık uzmanlar (Mixture of Experts – MoE) modelidir. 671 milyar parametre içerir ve 128.000 token’lik büyük bir giriş bağlam uzunluğunu destekler. Modelin her katmanında 256 uzman bulunur ve her token, değerlendirme için aynı anda sekiz farklı uzmana yönlendirilir.

R1’in gerçek zamanlı yanıt verebilmesi ve uzmanlara yönelik istem tokenlerini yönlendirebilmesi, yüksek hesaplama gücüne sahip çok sayıda GPU’nun, yüksek bant genişlikli ve düşük gecikmeli iletişimle bağlanmasını gerektirir. NVIDIA NIM (detaylı bilgi için bakınız: https://blog.openzeka.com/ai/nvidia-nim-olceklenebilir-yapay-zeka-cikarimi-icin-gelistirilmis-mikro-hizmetler/)mikroservisinin sunduğu yazılım optimizasyonları sayesinde, NVLink ve NVLink Switch ile birbirine bağlı sekiz H200 GPU içeren tek bir sunucu, 671 milyar parametreye sahip DeepSeek-R1 modelini saniyede 3.872 token hızında çalıştırabilir.

Bu verim, her katmanda NVIDIA Hopper mimarisinin FP8 Transformer Engine’ini ve MoE uzman iletişimi için 900 GB/sn NVLink bant genişliğini kullanarak mümkün hale gelir.

Bir GPU’dan FLOPS performansını elde etmek, gerçek zamanlı çıkarım için kritik öneme sahiptir. Yeni nesil NVIDIA Blackwell mimarisi, DeepSeek-R1 gibi akıl yürütme modellerinde test zamanı ölçeklemesine, 20 petaflopa kadar tepe FP4 hesaplama performansı ve çıkarım için özel olarak optimize edilmiş 72 GPU’lu bir NVLink alanı sağlayabilen beşinci nesil Tensor Çekirdekleriyle büyük bir destek sağlayacaktır. Beşinci nesil Tensor Çekirdekleri, 20 petaflop’a kadar FP4 tepe işlem gücü sunarken, 72 GPU’luk NVLink alanı özellikle çıkarım işlemleri için optimize edilmiştir.

DeepSeek-R1 NIM Mikroservisini Şimdi Deneyin

Geliştiriciler, DeepSeek-R1 NIM mikroservisini build.nvidia.com adresinde deneyimleyebilirler.

OPENZEKA HABERLERİ

OPENZEKA HABERLERİ

Hesaplarınızda paylaşmak ister misiniz?