Nasıl Yüklerim?

Öncelikle, aşağıdaki komutlar kullanılarak Node.js sürüm 22 veya 24 yüklenmelidir:

Ardından, OpenClaw’ı global olarak yüklemek için:

Kurulumdan sonra, OpenClaw’ı terminal üzerinden başlatmak için:

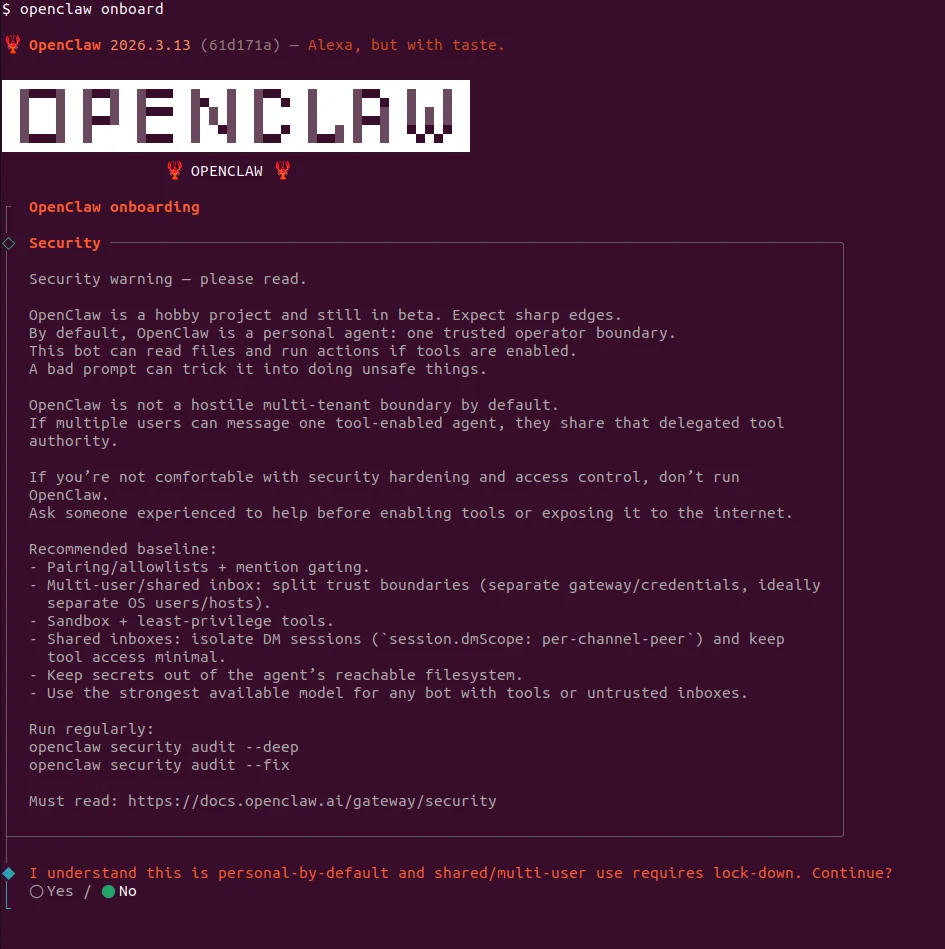

Güvenlik Uyarısı

Açılan ekran, aslında OpenClaw’ın “Güçlüyüm ama aynı zamanda tehlikeli olabilirim” mesajını verdiği bölümdür. Bu ekranda aşağıdaki uyarılar yer alır:

- “Bu bir chatbot değildir”

- “Prompt’larla manipüle edilebilirim”

- “Çok kullanıcılı kullanım tehlikelidir”

- “Güvenlik konusunda bilginiz yoksa kullanmayın”

OpenClaw gibi araçlara erişimi olan AI ajanlarını çalıştırırken, bu ajanları bir container (Docker) içinde izole etmek temel bir güvenlik katmanı sağlar.

Kurulum Adımları

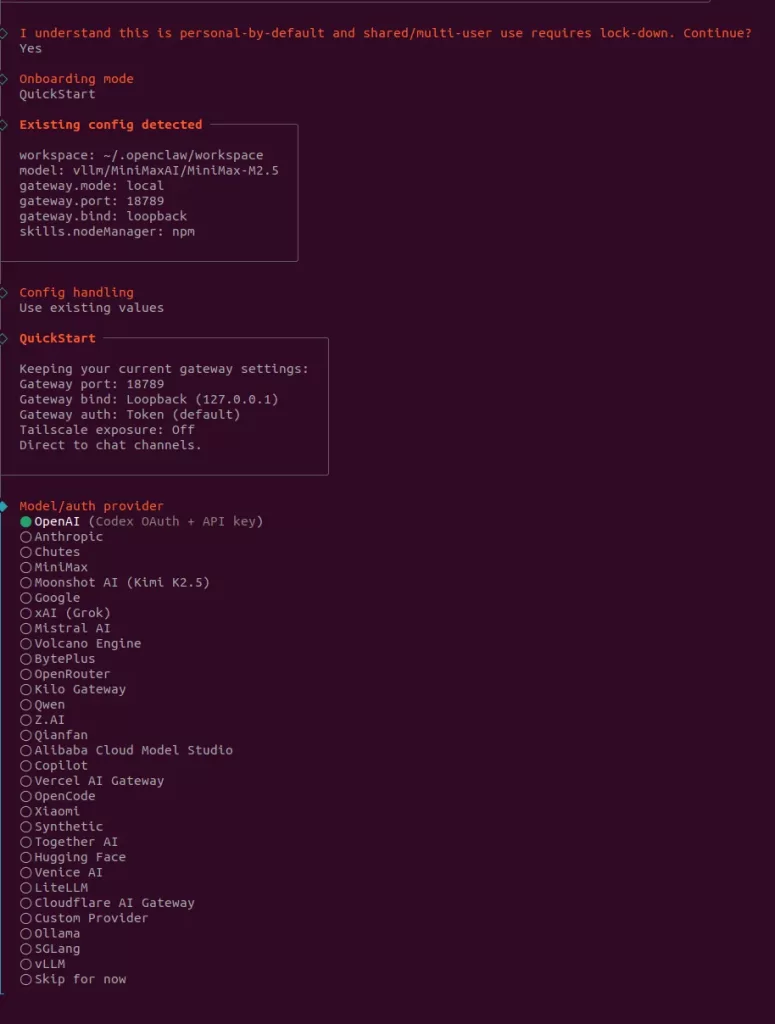

Kurulum sihirbazı sizden çeşitli yapılandırma ayarları isteyecektir:

1. Model ve Kimlik Doğrulama

Bu adımda OpenClaw için kullanılacak model ve kimlik doğrulama sağlayıcısını seçeriz. Yani ajanların hangi LLM’i kullanacağını ve bu modele nasıl bağlanacağını burada belirleriz.

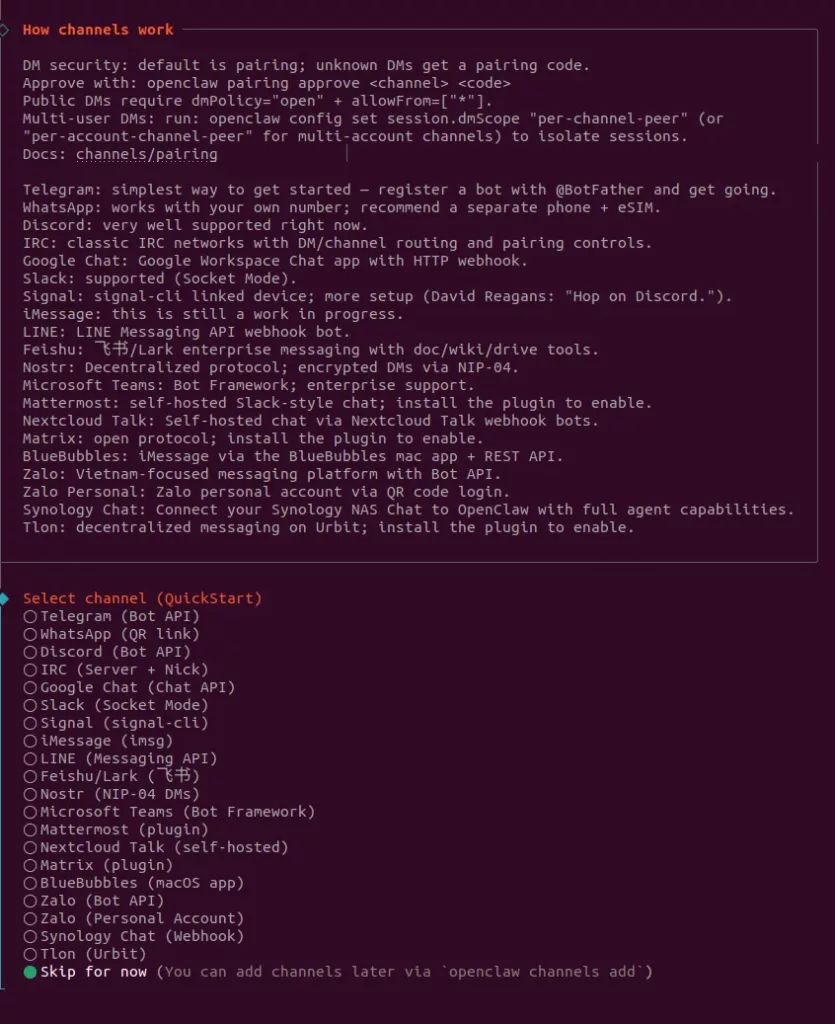

2. Platform Seçimi

Burada OpenClaw aracısının hangi platformda çalışacağını seçiyoruz (örneğin, Telegram, WhatsApp, Notion). Bu adımda, kullanıcıların aracıyla hangi kanal üzerinden iletişim kuracağını belirliyoruz.

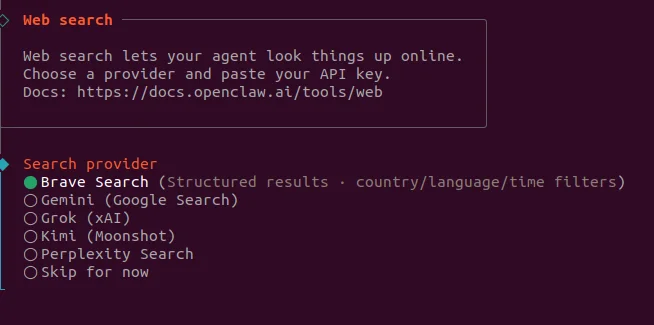

3. Arama Sağlayıcısı

Burada, OpenClaw ajanına internette arama yapma olanağı sağlayacak arama sağlayıcı hizmetini seçiyoruz. Bu adımda, ajanın web’de arama yaparken hangi arama motorunu (örneğin, Brave, Google, vb.) kullanacağını belirliyoruz.

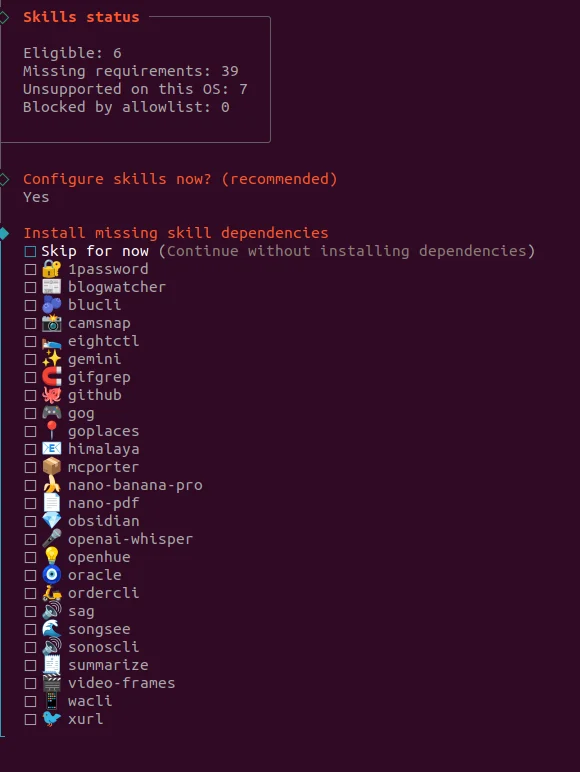

4. Yetenekler

Burada, OpenClaw ajanına hangi yeteneklerin ekleneceğini ve gerekli bağımlılıkların kurulup kurulmayacağını seçiyoruz. Bu adımda, ajanın hangi araçları kullanabileceğini belirliyoruz (örneğin, GitHub, web, dosya işlemleri vb.).

Clawhub.ai üzerinden yetenekleri (skills) ayrı ayrı indirmeniz de mümkündür. Seçtiğiniz bir yeteneği indirmek için:

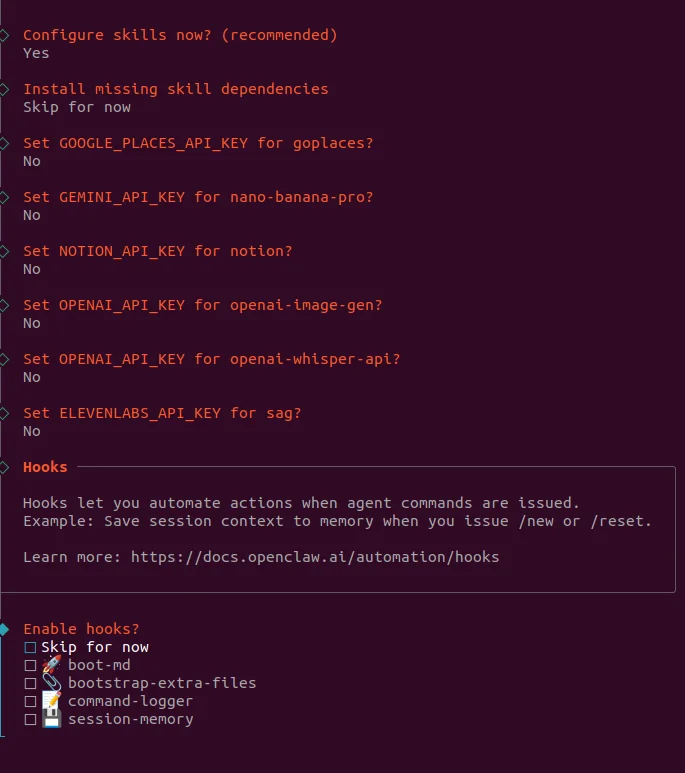

5. API Anahtarları ve Hook’lar

Bu bölümde, OpenClaw ajanına bağlı bazı yetenekler (skills) için API anahtarlarını girebilir ve otomasyon (hook) özelliklerini etkinleştirebilirsiniz. Bu adımda, ajanın harici servislerle entegre olup olmayacağını ve belirli komutlara karşı otomatik aksiyonlar alıp almayacağını belirleriz.

Hook nedir?

Hook’lar, OpenClaw içinde belirli bir olay gerçekleştiğinde otomatik olarak çalışan aksiyonlardır.

Örneğin, bir komut verdiğinizde ajan sizin ekstra bir işlem yapmanıza gerek kalmadan konuşmayı kaydedebilir veya hafızaya alabilir. Bu yapı, tekrar eden görevleri otomatikleştirir ve ajanın daha “akıllı” davranmasını sağlar.

Kısacası, hook’lar ajanın arka planda bazı işleri kendi kendine gerçekleştirmesine olanak tanır.

Masaüstü Uygulaması

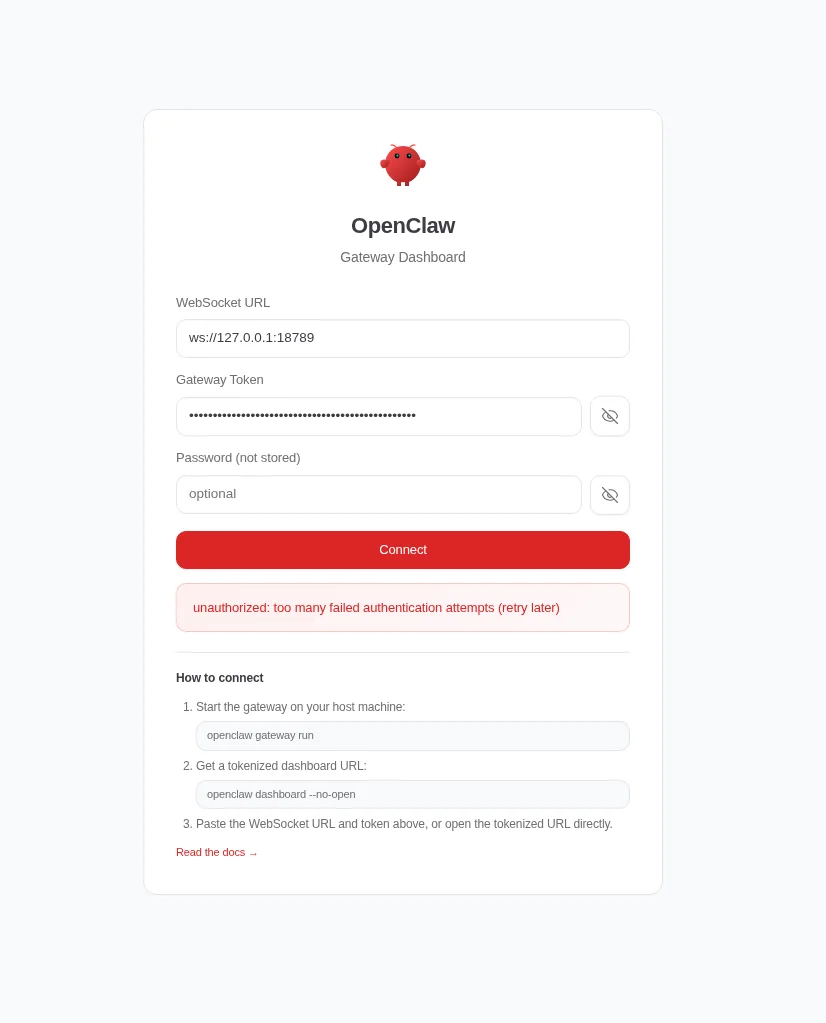

Komutu terminale yapıştırdıktan sonra size bir anahtar verilecektir. Bu anahtarı kullanarak OpenClaw’a dashboard üzerinden erişebilirsiniz.

vLLM ile Model Kurulumu

OpenClaw’ı NVIDIA Jetson cihazlarında (AGX Orin veya AGX Thor) çalıştırmak için aşağıdaki adımları izleyin. Bu talimatlar, LLM çıkarımı (inference) gerçekleştirmek için vLLM inference engine’ini bir Docker container içerisinde çalıştırır.

Adım 1: Reasoning Parser’ı İndirin

Reasoning model desteği için gerekli parser script’ini indireceğimiz dizini oluşturun. Ardından, NVIDIA-Nemotron-3-Nano modelinin reasoning (akıl yürütme) çıktısını parse eden özel Python script’ini HuggingFace üzerinden indirin.

Bu script, modelin “düşünme” sürecini (reasoning output) anlayabilmek için gereklidir.

Not: $HF_TOKEN ortam değişkeni, HuggingFace token’ınızı içermelidir.

Örneğin: export HF_TOKEN=hf_xxxx

Adım 2: Sistem Önbelleğini Temizleyin

Inference (çıkarım) performansını artırmak için bellek önbelleğini temizleyin:

Adım 3: vLLM Docker Konteynerini Başlatın

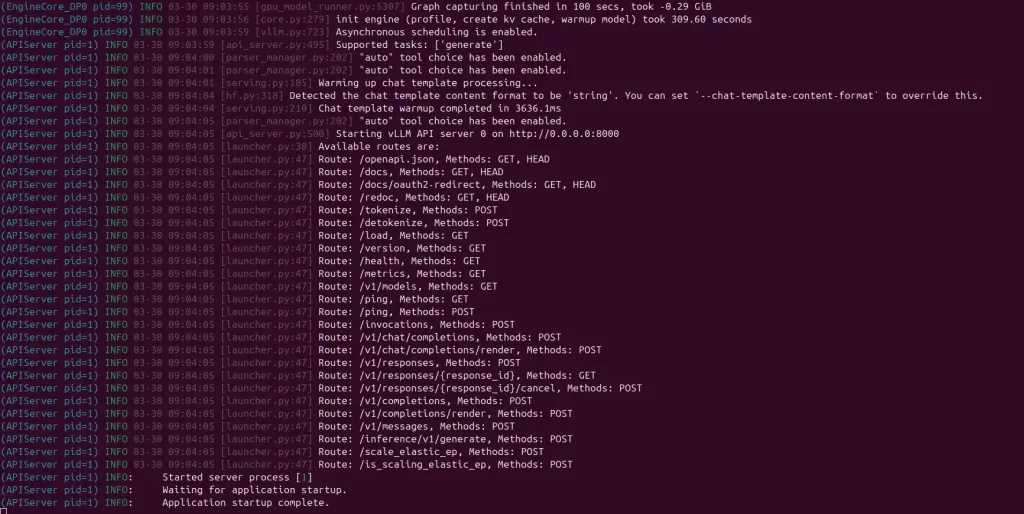

Bu komut, NVIDIA’nın Jetson için özel olarak derlediği vLLM görüntüsünü kullanarak çıkarım sunucusunu başlatır.

Parametre açıklamaları:

| Parametre | Açıklama |

|---|---|

| –runtime=nvidia | NVIDIA GPU Erişimi sağlar. |

| network host | Ağ erişimi sağlar (8000 portu üzerinden çalışır) |

| -e HF_TOKEN | HuggingFace model indirme için gerekli token |

| -v ~/vllm_plugins:/plugins | Parser script’ini container içine bağlar (mount eder) |

| -e VLLM_FLASHINFER_MOE_BACKEND=throughput | Yüksek throughput (verim) odaklı backend kullanır |

| -e VLLM_USE_FLASHINFER_MOE_FP4=1 | FlashInfer FP4 optimizasyonunu aktif eder |

Aşağıdaki kod bloklarından cihazınıza göre seçim yapabilirsiniz. (AGX Orin veya Thor)

AGX Orin için:

AGX Thor için:

Modelin yüklenmesi biraz zaman alabilir. Bu ekranı gördükten sonra devam edebilirsiniz.

Adım 4: OpenClaw Dashboard’u Başlatın

Komutu terminale girdikten sonra size bir anahtar (key) verilecektir. Bu anahtarı kullanarak OpenClaw’a dashboard üzerinden erişebilirsiniz.

Ajanlar Nasıl Kontrol Edilir?

OpenClaw’da bir ajanın davranışı, görevleri ve kimliği .md dosyaları ile tanımlanır. Bu dosyalar, ajanın hafızası, kişiliği ve yetenek yapılandırması gibi işlev görür.

Temel Dosyalar (Core Files)

OpenClaw’da bir ajanın davranışı, görevleri ve kimliği .md dosyaları ile tanımlanır. Bu dosyalar, ajanın hafızası, kişiliği ve yetenek yapılandırması gibi işlev görür.

| Dosya | Açıklaması |

|---|---|

| AGENTS.md | Ajanın nasıl çalışacağını tanımlayan ana dosyadır. Başlangıçta hangi dosyaların okunacağını ve nasıl davranacağını belirler. |

| SOUL.md | Ajanın karakterini, davranış stilini ve sınırlarını tanımlar. Yani ajanın “nasıl bir varlık” olduğunu belirler. |

| USER.md | Ajanın kiminle konuştuğunu ve kullanıcıya nasıl hitap edeceğini belirler. |

| IDENTITY.md | Ajanın adı, tarzı ve genel kimlik bilgilerini içerir. |

| TOOLS.md | Ajanın kullanabileceği araçları tanımlar. |

| HEARTBEAT.md | Ajanın periyodik kontroller yapmasını sağlar. Boşsa bir işlem yapmaz; doluysa belirli görevler düzenli olarak çalıştırılır. |

| BOOTSTRAP.md | Ajan ilk başlatıldığında kendini tanıtması için kullanılır. Genellikle kurulumdan sonra silinir. |

Not: Bu dosyalar genellikle aşağıdaki dizin altında bulunur:

/home/<username>/.openclaw/workspace

OpenClaw gibi modern AI ajanlarını edge ortamında verimli şekilde çalıştırmak için doğru donanım seçimi kritik önem taşır. NVIDIA Jetson platformları, güçlü GPU mimarisi ve enerji verimliliği sayesinde bu tür uygulamalar için ideal bir altyapı sunar.

Özellikle Jetson Orin Nano Super Developer Kit, Jetson AGX Orin Developer Kit ve yeni nesil Jetson AGX Thor platformu, farklı ölçeklerde AI ajanları geliştirmek ve çalıştırmak için yüksek performanslı çözümler sunmaktadır.

Bu sistemleri projelerinizde kullanarak, yerel (on-device) yapay zeka uygulamaları geliştirebilir, düşük gecikmeli ve güvenli çözümler oluşturabilirsiniz.

👉 İhtiyacınıza uygun NVIDIA Jetson platformlarını incelemek ve satın almak için mağazamızı ziyaret edebilirsiniz.

https://openzeka.com/urun-kategori/gelistirici-kitleri/

OPENZEKA HABERLERİ

OPENZEKA HABERLERİ

Hesaplarınızda paylaşmak ister misiniz?