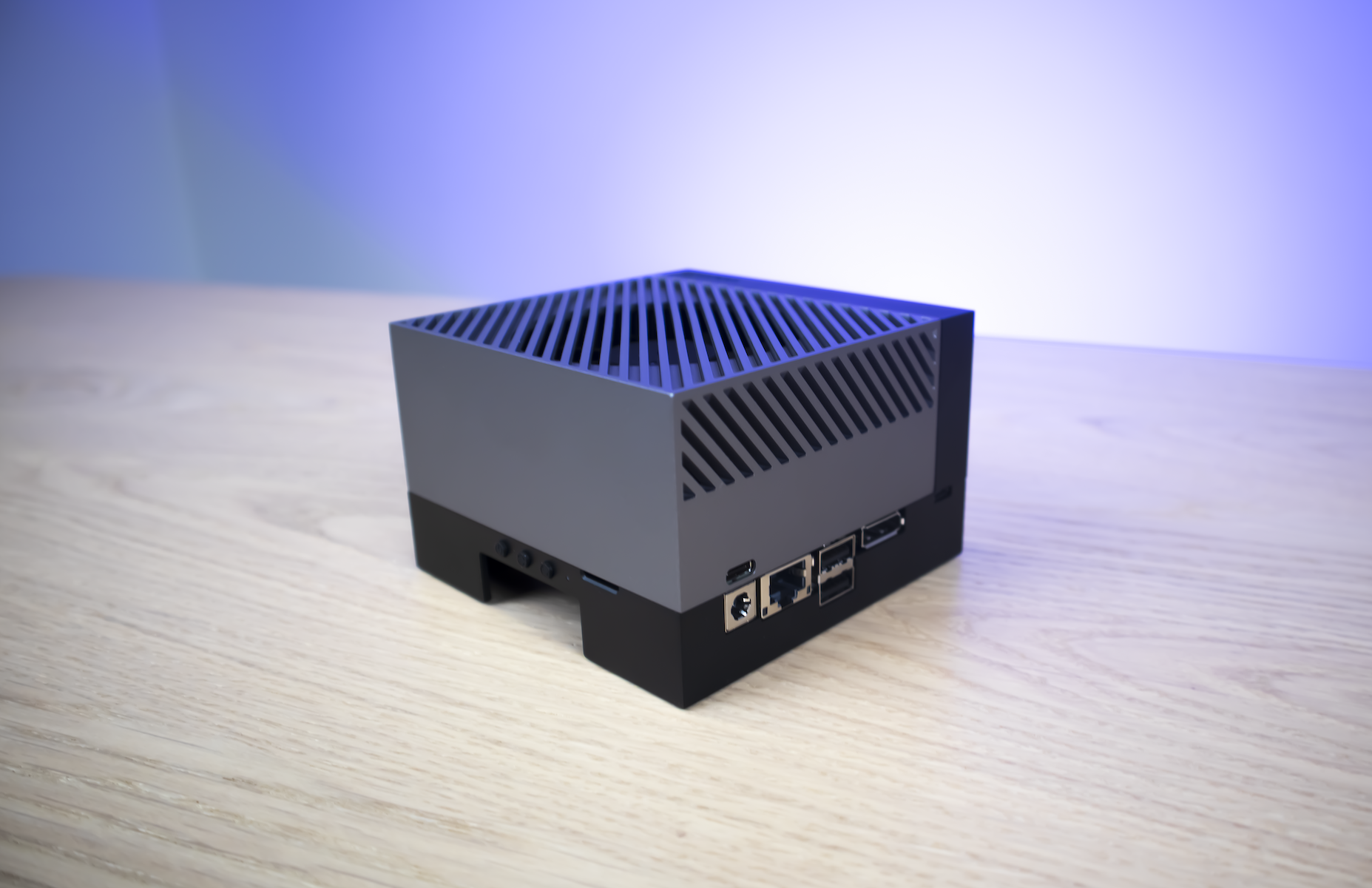

Eğer Jetson platformunu aktif olarak kullanıyorsanız, NVIDIA Jetson’ın en önemli özelliklerinden birinin CPU ve GPU’yu tek bir modül üzerinde bir araya getirip NVIDIA’nın geniş yazılım araçları ile uçta küçük boyutta ve düşük güç tüketimi ile çalıştırmak olduğunu bilirsiniz.

Peki derin öğrenme hızlandırıcı ile GPU üzerindeki iş yükünün bir kısmını bu işlem biriminin üzerine aktarıp bu performansı daha da artırabileceğinizi biliyor muydunuz?

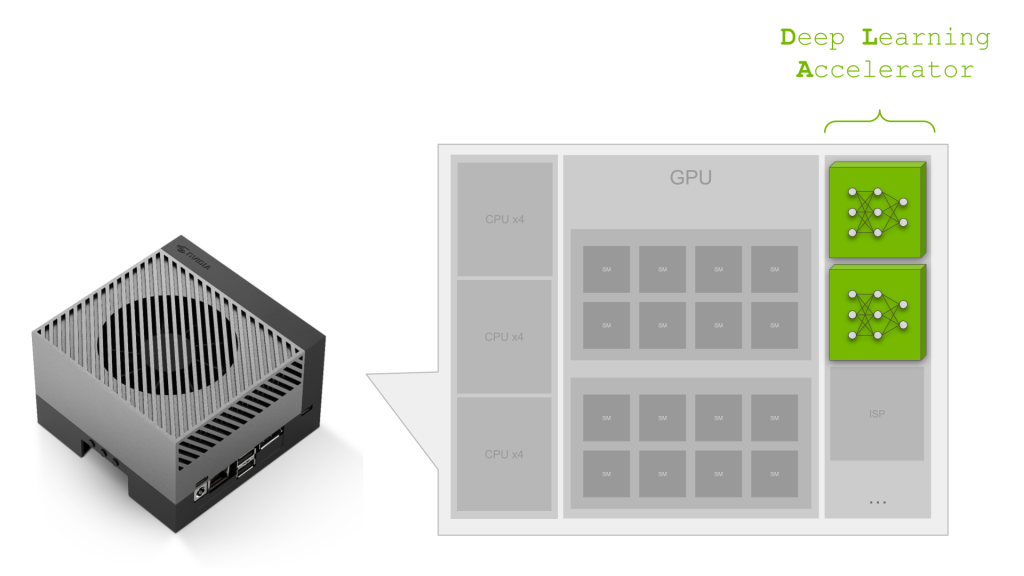

Jetson üzerinde CPU ve GPU’ya ek olarak donanım bazında hızlandırılmış encoder, decoder, görüntü işlemcisi ve derin öğrenme hızlandırıcı (DLA) gibi farklı işlem birimleri de bulunur. Bu derin öğrenme hızlandırıcı birim, Jetson AGX Xavier, Xavier NX, Jetson AGX Orin, Jetson Orin NX modüllerinde ve son çıkan NVIDIA DRIVE Xavier ve Orin tabanlı platformlarda bulunur. Derin öğrenme modellerinizi hızlandırmak için bu birimlerden faydalanabilirsiniz.

Derin öğrenme uygulamalarınızı çalıştırmak için sadece GPU kullanıyorsanız yazının devamında derin öğrenme hızlandırıcı ile modellerinizi nasıl daha hızlı hale getirebileceğinizi ve kazanacağınız avantajları keşfedebilirsiniz.

Derin Öğrenme Hızlandırıcı’ya (DLA) Genel Bakış

DLA, modern yapay sinir ağı yapılarında bulunan convolution ve pooling gibi işlemleri verimli bir şekilde gerçekleştirmek için özelleştirilmiş entegre bir devredir. DLA’nın GPU’lar kadar geniş bir yelpazesi olmasa da çoğu popüler yapay sinir ağı mimarisinde bulunan katman yapılarını destekler.

Geliştirdiğiniz modeller DLA’nın desteklediği katman yapılarını zaten içeriyor alıyor olabilir. Örnek olarak, NVIDIA TAO Toolkit içerisinde bulunan hareket algılamadan nesne tanımaya kadar birçok pre-trained modelin DLA desteği bulunur.

DLA’nın işlem kapasitesi GPU’dan az olmasına rağmen gücü daha verimli kullanıp derin öğrenme işlemleri sırasında GPU’nun yükünü hafifletir ve diğer işlere daha fazla işlem kapasitesinin ayrılabilmesini sağlar. Bu sayede, geliştirdiğiniz uygulamaya göre değişmekle beraber, aynı modeli hem GPU hem de DLA üzerinde çalıştırıp toplamda daha fazla işlem kapasitesi elde edebilirsiniz.

Birçok NVIDIA Jetson geliştiricisi derin öğrenme uygulamalarını optimize etmek için hali hazırda DLA kullanıyorlar. Örnek olarak Postmates, teslimat robotlarında kullandığı uygulamaları Jetson AGX Xavier üzerindeki GPU ve DLA’yı birlikte kullanarak optimize ediyor. Aynı şekilde Cainiao ET Lab, lojistik araçlarını DLA kullanarak optimize ediyor.

Eğer siz de derin öğrenme uygulamanızı tamamen optimize etmek istiyorsanız optimizasyon sürecinde ilgilenmeniz gereken kısımlardan birisi mutlaka DLA olmalıdır.

Derin Öğrenme Hızlandırıcı Nasıl Kullanılır?

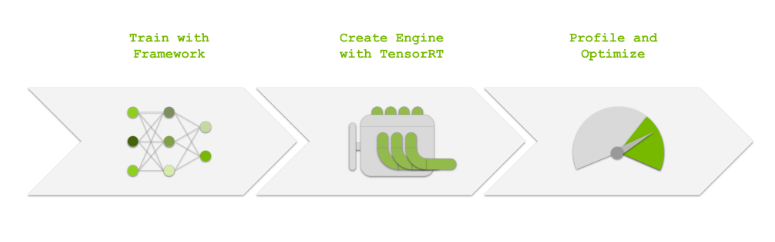

DLA’yı kullanmak için öncelikle derin öğrenme modelinizi PyTorch vey TensorFlow gibi bir kütüphane ile eğitmelisiniz. Sonrasında eğittiğiniz derin öğrenme modelini NVIDIA TensorRT’ye aktarıp optimize etmelisiniz. TensorRT ile kullanacağımız DLA engine dosyasını oluşturabilir ve oluşturduğumuz dosyayı çalıştırabiliriz. Son olarak, DLA uyumluluğunu en üst düzeye çıkartacak şekilde optimize etmeli ve modları ayarlamalısınız.

Derin Öğrenme Hızlandırıcıya Genel Bakış

NVIDIA AI IOT tarafından hazırlanan Jetson DLA Tutorial ile geliştirdiğiniz derin öğrenme modellerini DLA’ya özel olarak optimize etmek için gereken temel bilgileri öğrenebilirsiniz.

Bu eğitim içeriğini takip ederek CIFAR10 veri seti ve PyTorch ile model tanımlamayı ve eğitmeyi, eğittiğiniz modeli TenorRT’ye aktarmayı, NVIDIA Nsight System Profiler ile performans analizi yapmayı, daha iyi DLA performansı için modeli güncellemeyi, INT8 ile çalıştırmak için kalibrasyon yapmayı öğrenebilirsiniz.

Daha Fazlası İçin

Derin Öğrenme Hızlandırıcı (DLA) ile ilgili daha fazla bilgi için ürün sayfasını, DLA üzerinde hazır olarak çalıştırabileceğiniz pre-trained modeller için TAO Toolkit‘i ve performans karşılaştırmalarını inceleyebilirsiniz.

NVIDIA Jetson Platformu’nun en yeni ve güçlü serisi olan Jetson AGX Orin Geliştirici Kiti‘ni mağazamız üzerinden satın alabilirsiniz.

Yazının kaynağına buradan ulaşabilirsiniz.

OPENZEKA HABERLERİ

OPENZEKA HABERLERİ

Hesaplarınızda paylaşmak ister misiniz?