NVIDIA geçtiğimiz günlerde Jetson Generative AI Lab’ı tanıttı. Bu, geliştiricilere NVIDIA Jetson uç cihazlarında üretken yapay zeka(Generative AI) alanında sınırsız olasılıkları gerçek dünya koşullarında keşfetme imkanı sunuyor. Diğer gömülü platformlardan farklı olarak, Jetson büyük dil modelleri (LLMs), görüntü dönüştürücüler ve kararlı difüzyonu (stable diffusion) yerel olarak çalıştırma yeteneğine sahiptir. Bu, Jetson AGX Orin’de en büyük Llama-2-70B modelinin etkileşimli hızlarda çalıştırılabilmesini de içerir.

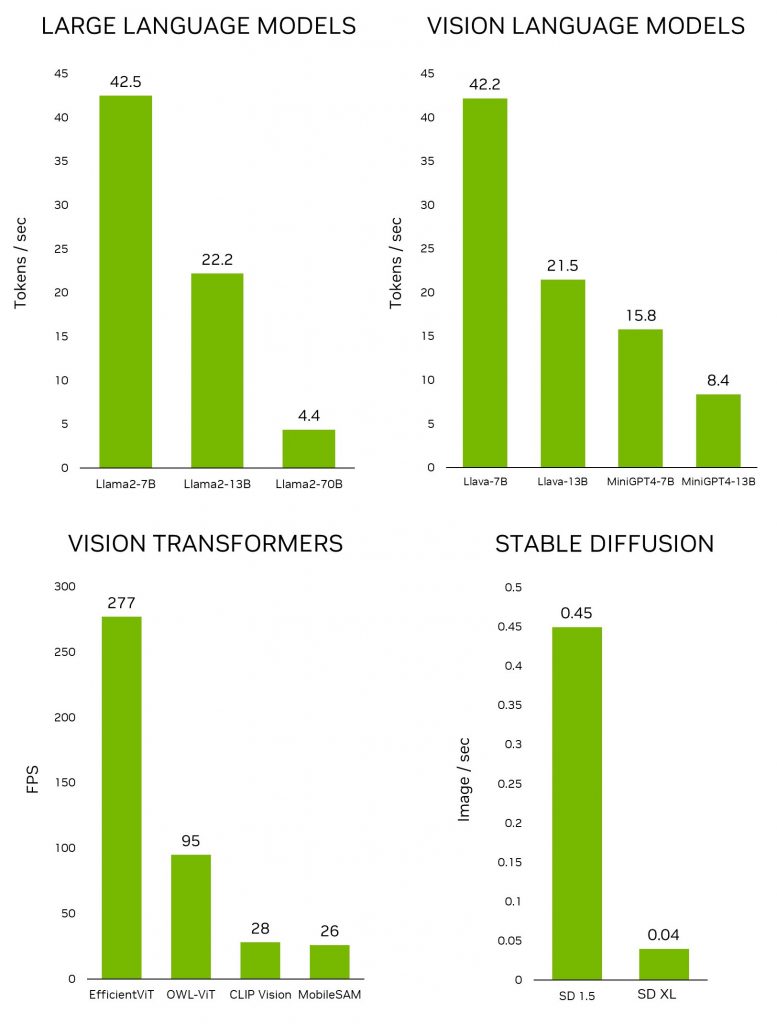

Şekil 1. Jetson AGX Orin üzerindeki önde gelen Üretken Yapay Zeka modellerinin çıkarım performansı

Jetson üzerinde en yeni modelleri ve uygulamaları hızlı bir şekilde test etmek için, Jetson Generative AI laboratuvarı tarafından sunulan rehberler ve kaynakları kullanabilirsiniz.

Bu yazıda, Jetson cihazlarında çalıştırabileceğiniz heyecan verici üretken yapay zeka uygulamalarını birlikte keşfediyor olacağız. Bu uygulamaların tümü laboratuvar rehberlerinde kapsamlı bir şekilde ele alınmıştır.

Uçta Üretken Yapay Zeka

Hızla evrilen yapay zeka alanında, üretken modellere ve özellikle aşağıda sıralanan konulara yoğun bir ilgi mevcut:

- İnsan benzeri konuşmalara katılabilen LLM’ler.

- LLM’lere kamera aracılığıyla gerçek dünyayı algılama ve anlama yeteneği kazandıran Görüntü Dil Modelleri (VLM’ler).

- Basit metin girişlerini etkileyici görsellere dönüştürebilen Diffüzyon modelleri.

Bu dikkate değer yapay zeka gelişmeleri birçok insanın ilgisini çekmekte ve hayal gücünü harekete geçirmektedir. Ancak, bu son teknoloji modelleri destekleyen altyapılara derinlemesine bakarsak, genellikle bulut ile bağlantılı olduklarını ve işlem gücünü veri merkezlerinden aldıklarını görebiliriz. Bu bulut merkezli yaklaşım, yüksek bant genişliği ve düşük gecikmeli veri işlemesi gerektiren bazı uç uygulamalarının geliştirilmesini ve kullanılmasını engellemektedir.

LLM’ler ve diğer üretken modelleri yerel ortamlarda çalıştırma eğilimi, geliştirici topluluklarında ivme kazanıyor. Reddit gibi canlı online topluluklar, r/LocalLlama gibi, ilgililerin üretken yapay zeka teknolojilerindeki son gelişmeleri ve gerçek dünya uygulamalarını tartışabilecekleri bir platform sunuyor. Medium gibi platformlarda yayınlanan birçok teknik makale, açık kaynaklı LLM’leri yerel ortamda çalıştırmanın inceliklerine iniyor. Bu platformlardaki kullanıcıların NVIDIA Jetson’dan faydalandığını görüyoruz.

Jetson Generative AI Lab, en son üretken yapay zeka modellerini ve uygulamalarını keşfetme merkezi olarak hizmet vermektedir. Bu alan hızla gelişirken, yeni üretken yapay zeka modelleri neredeyse günlük olarak ortaya çıkıyor ve sayısallaştırma (quantization) kütüphanelerindeki gelişmeler performans ölçütlerini hızla yeniden şekillendiriyor. Bu kapsamda; NVIDIA, en güncel bilgiyi ve etkili araçları sunmanın öneminin farkında olarak, kolayca takip edilebilen eğitimler ve önceden oluşturulmuş konteynerler sunmaktadır.

Jetson cihazları için konteynerler oluşturmak amacıyla tasarlanmış ve titizlikle sürdürülen bir açık kaynak proje ve “jetson-containers” adını taşımaktadır. Bu projede, GitHub Actions kullanılarak CI/CD yaklaşımıyla 100 konteyner oluşturulmaktadır. Bu konteynerler, arka planda çalışan araçlar ve kütüphaneleri yapılandırma gereksinimi olmadan Jetson üzerinde en yeni yapay zeka modellerini, kütüphanelerini ve uygulamalarını hızlı bir şekilde test etmenize olanak sağlar.

Uygulama Kılavuzu

NVIDIA Jetson cihazlarda çalıştırılabilen Jetson Generative AI Lab’de bulunan NVIDIA Jetson cihazında çalışan üretken yapay zeka uygulamalarından bazılarını tanıyalım.

Şekil 2. Kararlı Difüzyon Arayüzü

A1111’nin “stable-diffusion-webui” adlı uygulaması, Stability AI tarafından geliştirilen Stable Diffusion’ı kullanmanızı sağlayan kullanıcı dostu bir arayüz sunar. Bu uygulama, aşağıdaki işlemleri gerçekleştirmenize olanak tanır:

- Txt2img: Metin girdisine dayalı olarak bir görüntü oluşturur.

- img2img: Giriş görüntüsü ve ilgili metin girdisi kullanılarak bir görüntü oluşturur.

- inpainting: Giriş görüntüsünün eksik veya maskeleme yapılmış bölgelerini doldurur.

- outpainting: Giriş görüntüsünü orijinal sınırlarının ötesine genişletir.

Web uygulaması, ilk başlatıldığında Stable Diffusion v1.5 modelini otomatik olarak indirir, böylece hemen görüntü oluşturmaya başlayabilirsiniz. Jetson Orin cihazınız varsa, bu işlemi aşağıdaki komutları uygulayarak kolayca gerçekleştirebilirsiniz. Bu adımlar rehberde de detaylı bir şekilde açıklanmıştır.

Stable-diffusion-webui’nin nasıl çalıştırılacağı hakkında daha fazla bilgi için, Jetson Generative AI lab rehberine başvurabilirsiniz. Jetson AGX Orin ayrıca daha yeni Stable Diffusion XL (SDXL) modellerini çalıştırabilme yeteneğine sahiptir. Yukarıda yer alan görüntü bu modeller kullanılarak oluşturmuştur.

Şekil 3. Jetson AGX Orin üzerinde Llama-2-13B ile etkileşimli sohbet

Oobabooga’nın “text-generation-webui” adlı uygulaması, yerel bir ortamda LLM’leri çalıştırmak için Gradio tabanlı popüler bir web arayüzüdür. Resmi repo, platformlar için tek tıklamayla kurulum seçenekleri sunar. Ancak jetson-containers, daha da kolay bir yöntem sunar.

Bu arayüzü kullanarak, Hugging Face model reposundan bir modeli kolayca indirebilirsiniz.

Genel bir kural olarak, 4-bit niceleme; Jetson Orin Nano 7B parametreli bir modeli, Jetson Orin NX 16GB 13B parametreli bir modeli ve Jetson AGX Orin 64GB ise 70B parametreli bir modeli çalıştırabilir.

Birçok insan şu anda araştırma ve ticari kullanım için ücretsiz olarak sunulan Meta’nın açık kaynak büyük dil modeli olan Llama-2 üzerinde çalışıyor. Llama-2 tabanlı modeller, gözetimli ince ayarlama (SFT) ve insan geri bildirimiyle pekiştirmeli öğrenme (RLHF) gibi teknikler kullanılarak eğitiliyor. Bazıları, Llama-2’nin bazı karşılaştırmalarda GPT-4’ü aştığını iddia ediyor.

Text-generation-webui eklentilere sahiptir. Ayrıca kendi eklentilerinizi geliştirmenize imkan verir. Bu, ileride llamaspeak örneğinde gördüğünüz gibi uygulamanızı entegre etmek için kullanılabilir. Ayrıca, Llava gibi çoklu arayüzlü Görüntü ve Metin Dil Modellerini (VLM) destekler ve görüntülerle ilgili sohbet etme gibi işlevlere sahiptir.

Şekil 4. Sayısallaştırılmış Llava-13B VLM görsel sorguları cevaplıyor

text-generation-webui’nin nasıl çalıştırılacağı hakkında daha fazla bilgi için, Jetson Generative AI lab rehberine başvurabilirsiniz

llamaspeak

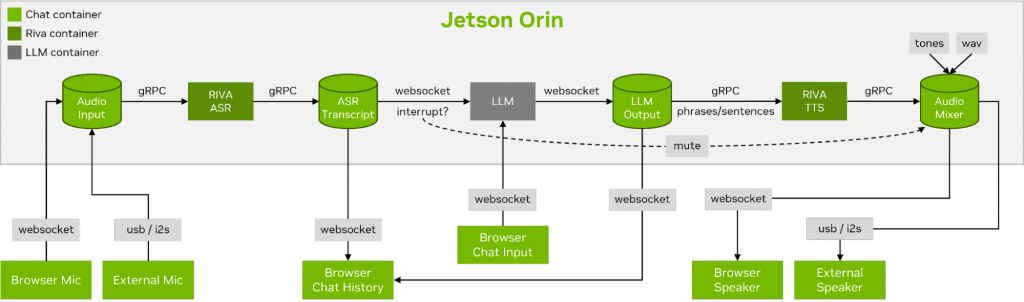

Şekil 5. Riva ASR/TTS ile çalışan bir LLM kullanarak llamaspeak sesli konuşma.

Llamaspeak, yerel olarak çalışan bir LLM ile sözlü konuşmaları gerçekleştirmenize olanak tanımak için canlı NVIDIA Riva ASR/TTS kullanan etkileşimli bir sohbet uygulamasıdır. Şu anda jetson-containers’ın bir parçası olarak sunulmaktadır.

Düzgün ve kesintisiz bir sesli konuşma gerçekleştirmek için bir LLM’nin ilk çıktı jetonuna llamaspeak, tarayıcı mikrofonlarından veya Jetson cihazınıza bağlı bir mikrofondan düşük gecikmeli ses akışı ile yanıt veren duyarlı bir arayüze sahiptir. Daha fazla bilgi için jetson-containers belgelerini inceleyebilirsiniz.

Şekil 6. Web istemcilere yönlendirilen ASR/LLM/TTS boru hattı ile canlı konuşma kontrol akışı

NanoOWL

Şekil 7. NanoOWL, gerçek zamanlı nesne tespiti yapabilir.

Open World Localization with Vision Transformers (OWL-ViT), Google Research tarafından geliştirilen bir yaklaşımdır. Bu model, nesneleri metin komutları ile tespit etmenizi sağlar. Örneğin, “bir kişi, bir araba” gibi metinlerle insanları ve arabaları tespit edebilirsiniz. Yeni uygulamalar geliştirmek için ayrı bir model eğitimine gerek kalmadan hızlı bir şekilde kullanabilirsiniz.

NanoOWL projesi, NVIDIA TensorRT ile optimize edilerek gerçek zamanlı performans elde etmenizi sağlamak için geliştirildi. Bu performans, OWL-ViT’i yaygın kamera kare hızlarının çok üzerinde çalıştırmanıza olanak tanır.

Proje ayrıca hızlandırılmış OWL-ViT modelini CLIP ile birleştirmenizi sağlar, böylece herhangi bir nesneyi tanımlamadan ve sınıflandırmadan önce tespit edebilirsiniz. Örneğin, yüzleri tespit edip mutlu veya üzgün olduklarını sınıflandırmak için “[bir yüz (mutlu, üzgün)]” gibi komutlar kullanabilirsiniz.

Bu modelin doğruluğu bazı nesneler için daha iyi olabilir, ancak geliştirme kolaylığı sayesinde farklı komutları hızla deneyerek sizin için işe yarayıp yaramadığını görebilirsiniz.

NSegment Anything Model

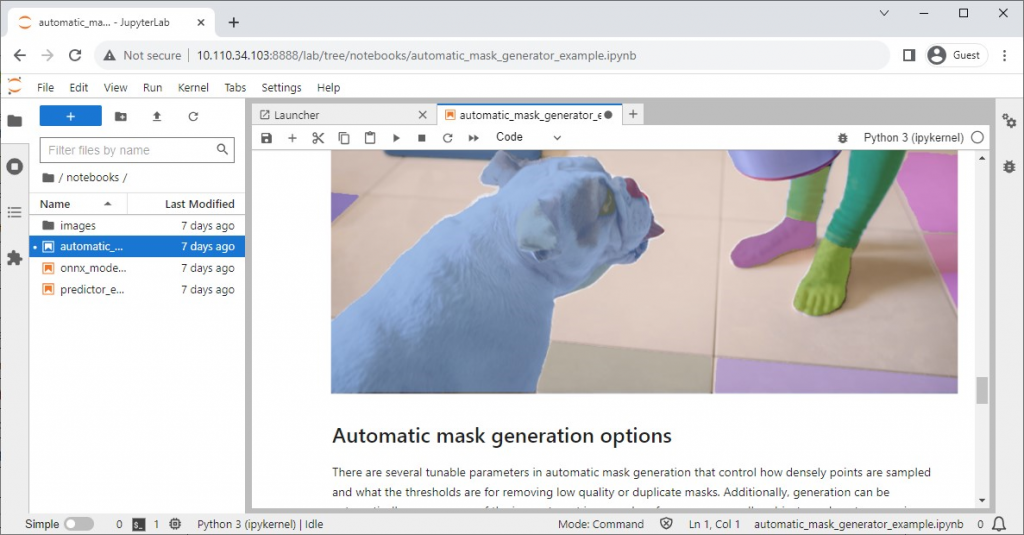

Şekil 8. Segment Anything Model (SAM) Jupiter Notebook Arayüzü

Meta, nesneleri resimler içerisinde karmaşıklık veya bağlamdan bağımsız olarak hassas bir şekilde tanımlamak ve ayırmak için tasarlanmış gelişmiş bir model olan “Segment Anything Model“i (SAM) piyasaya sürdü. Resmi reposunda, modelin etkisini kolayca kontrol etmek için Jupyter defterleri bulunmaktadır. Ayrıca Jupyter Lab özellikli kullanışlı bir konteyner olan “jetson-containers” da burada sunulmaktadır.

NanoSAM

Şekil 9. NanoSAM Gerçek Zamanlı Segmentasyonu

Segment Anything (SAM), noktaları ayırma maskelerine dönüştürebilen olağanüstü bir modeldir. Ancak, SAM gerçek zamanlı çalışmaz. Bu nedenle uç uygulamalarda kullanımı sınırlıdır.

Bu sınırlamayı aşmak için yeni bir proje olan NanoSAM piyasaya sürüldü. NanoSAM, SAM görüntü kodlayıcısını hafif bir modele sıkıştırır. Ayrıca modeli NVIDIA TensorRT ile optimize eder. Böylece NVIDIA Jetson Orin platformlarında gerçek zamanlı performansı mümkün kılar. Bu sayede, mevcut sınırlama kutusu veya anahtar nokta tespitinizi eğitim gerektirmeden bir örnek modele dönüştürebilirsiniz.

Track Anything Model

The Track Anything Model (TAM), “Segment Anything’in videolarla buluştuğu” bir modeldir. Onların açık kaynaklı Gradio tabanlı arayüzü, girilen videonun bir karesine tıklayarak takip edilmesi ve bölümlenmesi gereken herhangi bir şeyi belirlemenizi sağlar. Ayrıca, takip edilen nesneyi iç boyama ile kaldırma yeteneğini de sergiler.

Şekil 10. Track Anything Arayüzü

NanoDB

Uçta verilerinizi etkili bir şekilde dizinlemek ve aramak için, bu vektör veritabanları genellikle yerleşik bağlam uzunluğunun ötesinde uzun vadeli bellek için Kurtarma-Artırılmış Üretim (RAG) için LLM’lerle birlikte kullanılır (Llama-2 modelleri için 4096 belirteç). Görüntü-dil modelleri de aynı gömme bilgilerini giriş olarak kullanır.

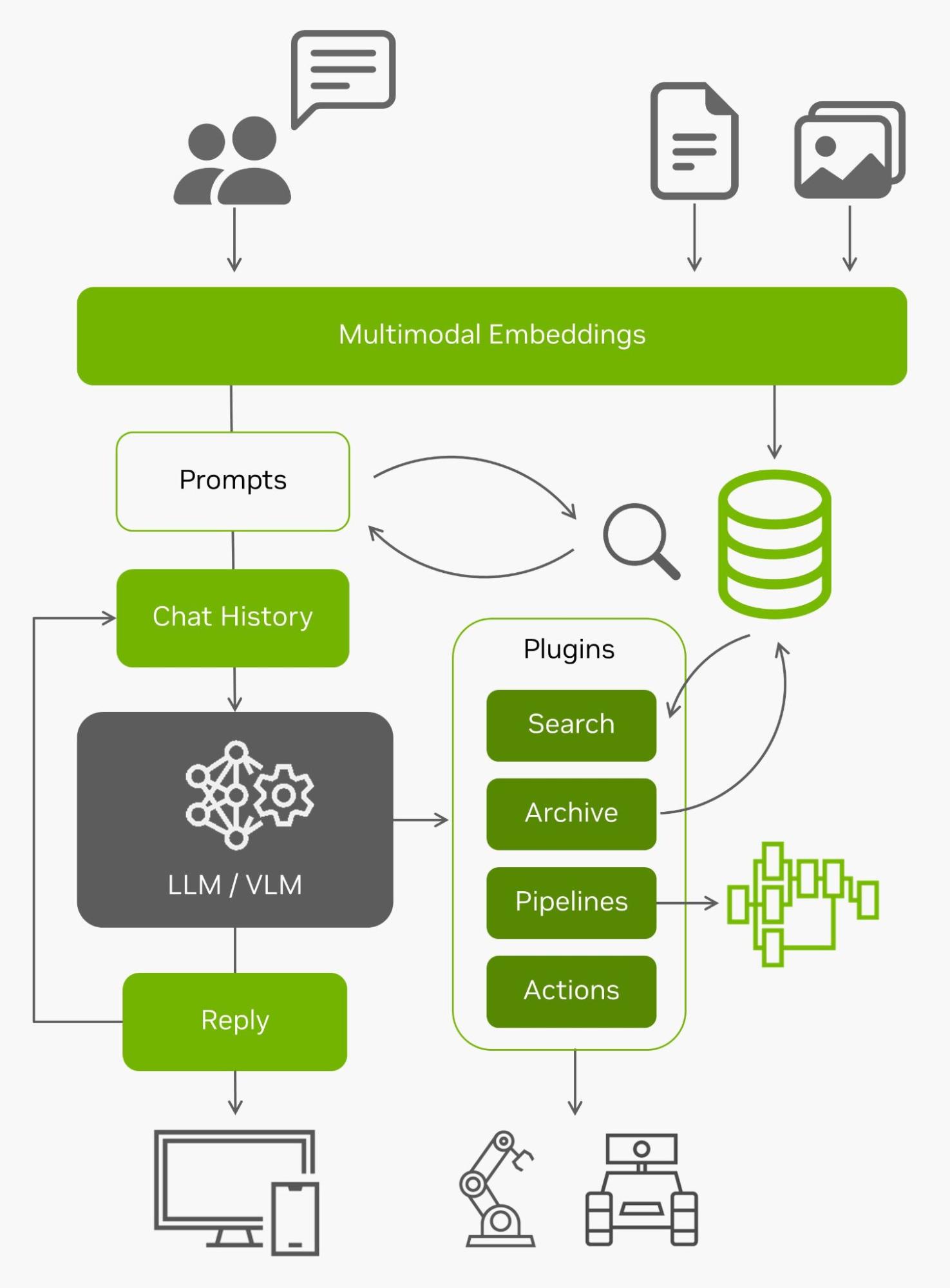

Şekil 11. LLM/VLM Mimarisi

Tüm bu uçtan gelen canlı veriler ve onları anlama yeteneği sayesinde, gerçek dünyayla etkileşimde bulunabilen elemanlar haline gelirler. Kendi görsel verileriniz ve veri kümenizle NanoDB kullanma deneyleri hakkında daha fazla bilgi için laboratuvar rehberine göz atın.

Sonuç

Siz de benzer çalışmalar gerçekleştirmek için yeni NVIDIA Jetson Orin Nano‘nun gücünden faydalanabilirsiniz.

Projenize uygun yapay zeka bilgisayarınızı seçmek için mağazamızı ziyaret ediniz.

Yazının kaynağına buradan ulaşabilirsiniz.

OPENZEKA HABERLERİ

OPENZEKA HABERLERİ

Hesaplarınızda paylaşmak ister misiniz?