NVIDIA araştırmacıları bir demoda, SIGGRAPH 2021’in Gerçek Zamanlı demosu Real-Time-live için bir dijital avatar teknolojisi hizmetine dört AI modelini yerleştirdi ve Best in Show ödülünü kazandı.

Bilgisayar grafikleri konferansında dünyanın en büyük ve en çok beklenen etkinliklerinden biri olan bu demo, bu yıl sanal ortamda düzenlendi. Oyun teknolojisi, artırılmış gerçeklik ve bilimsel görselleştirmeyi içeren son teknoloji gerçek zamanlı projeler ödüllendirdi. Unity Technologies, Rensselaer Polytechnic Institute, NYU Future Reality Lab ve başka şirketlerden gelen sunucuların da yer aldığı bu demo jüri tarafından incelenen bir dizi interaktif projeye yer verdi.

Silikon Vadisi NVIDIA genel merkezinden canlı yayın yapan NVIDIA Araştırma ekibi, bant genişliği açısından verimli geliştirmeler içeren video konferans ve hikaye anlatımı gibi projeler için gerçeğe yakın sanal karakterler oluşturabilen yapay zeka modelleri koleksiyonunu sundu.

Proje demosu, tek bir fotoğraftan dijital avatarlar oluşturmak, avatarları doğal 3B yüz hareketiyle canlandırmak ve metni konuşmaya dökmek için araçlar içeriyordu.

NVIDIA uygulamalı derin öğrenme araştırmaları başkan yardımcısı Bryan Catanzaro, sunumda “Dijital avatarlar yapmak herkesin bildiği gibi zor, sıkıcı ve pahalı bir süreç. Ancak yapay zeka araçları ile gerçek insanlar ve çizgi film karakterleri için dijital avatarlar oluşturmanın kolay bir yolu var. Video konferans, hikaye anlatımı, sanal asistanlar ve diğer birçok uygulama için kullanılabilir” dedi.

Yapay Zeka, Mülakatları Mükemmelleştiriyor

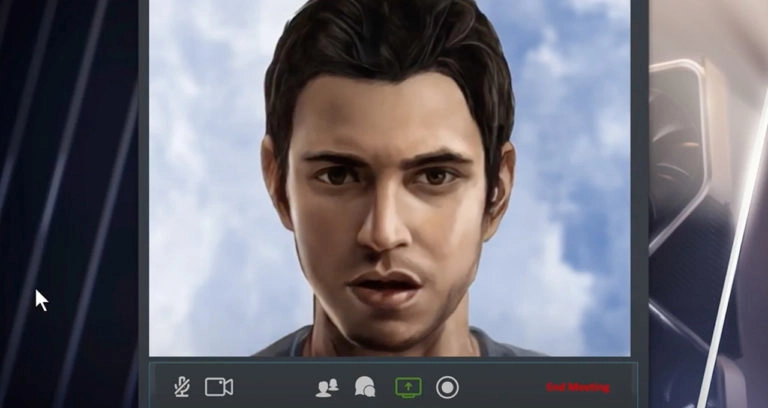

Demoda, iki NVIDIA araştırmacısı, video konferans üzerinden iletişim kuran bir mülakatçıyı ve iş için görüşme yapan bir aday rolünü oynadılar. Aday, görüşme sırasında görevli ile iletişim kurmak için yapay zeka ile çalışan dijital avatar teknolojisinin yeteneklerini gösterdi.

Aday rolünü oynayan araştırmacı baştan sona bir NVIDIA RTX dizüstü bilgisayara güvenirken, görevli RTX A6000 GPU’lar tarafından desteklenen bir masaüstü iş istasyonunu kullandı. Tüm işlem hattı, buluttaki GPU’larda da çalıştırılabilir.

Bir kampüs kafesinde otururken, beyzbol şapkası ve yüz maskesi takan aday, video görüşmesinde yakalı bir gömlek içinde temiz tıraşlı görünmek için Vid2Vid Cameo modelini kullandı. Bu yapay zeka modeli, 3B tarama veya özel eğitim görüntüleri gerektirmeden, tek bir fotoğraftan gerçekçi dijital avatarlar oluşturuyor.

“Dijital avatar anında oluşuyor. Bu yüzden farklı bir fotoğraf kullanarak çok hızlı bir şekilde farklı bir avatar oluşturabilirim” dedi ve modelin kapasitesini kendisinin başka iki fotoğrafıyla gösterdi.

Araştırmacının sistemi, video akışı iletmek yerine yalnızca araştırmacının sesini gönderdi. Ardından bu ses, NVIDIA Omniverse Audio2Face uygulamasına girdi olarak verildi. Audio2Face, 3B baş modelinde ses girişini gerçek zamanlı olarak eşleştirmek için başın, gözlerin ve dudakların doğal hareketini oluşturuyor. Oluşturulan bu yüz animasyonu da, sunucunun dijital avatarıyla doğal görünümlü hareketi sentezlemek için Vid2Vid Cameo’ya girdi olarak verildi.

Araştırmacı, yalnızca fotogerçekçi dijital avatarlar için değil, aynı zamanda animasyonlu bir karakteri seslendirmek için de konuşmasını Audio2Face ve Vid2Vid Cameo aracılığıyla destekledi. Geliştiricilerin NVIDIA StyleGAN kullanarak çizgi film karakterleri veya resimler tarzında modellenen sonsuz dijital avatarlar oluşturabileceklerini açıkladı.

Araştırmacı, daha da ileri giderek, kafenin çevresi çok gürültülü olduğunda, RAD-TTS modelinin yazılan mesajları sesine dönüştürebildiğini ve Audio2Face’le beslenen sesin yerini aldığını gösterdi. Çığır açan bu derin öğrenme tabanlı araç, milisaniyeler içinde rastgele metin girişlerinden gerçeğe yakın konuşmayı sentezleyebilir.

“Connecting in the Metaverse: The Making of the GTC Keynote” adlı belgeselimizin galasını izleyebilirsiniz.

Yazının kaynağına buradan ulaşabilirsiniz.

OPENZEKA HABERLERİ

OPENZEKA HABERLERİ

Hesaplarınızda paylaşmak ister misiniz?